超越英伟达,这事儿靠谱吗?

作为一个长期关注AI算力的科技爱好者,最近看到一个爆炸性新闻——华为CloudMatrix 384在多项关键指标上竟然超过了英伟达的旗舰产品GB200 NVL72。说实话,第一眼看到这个消息的时候,我还以为是标题党。

但随着我查阅了多个来源,包括来自36氪、虎嗅APP、观察者网等媒体的报道,以及国际知名机构SemiAnalysis的专业分析,我才意识到这不是简单的营销炒作,而是实打实的技术突破。

技术硬核解析:华为到底做了什么?

根据官方介绍,CloudMatrix 384基于384颗昇腾芯片构建,采用全互连拓扑架构,实现芯片间高效协同。这套系统能提供高达300 PFLOPs的密集BF16算力,几乎接近英伟达NVL72的两倍。

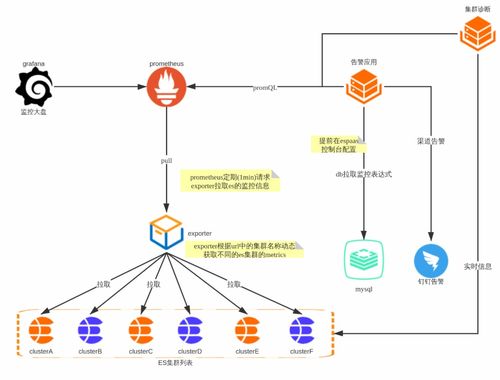

更让我震惊的是互联带宽的提升。传统方案多依赖以太网,而华为这次直接跳出了这个框架,采用了共享总线网络,将资源互联带宽提升了10倍以上。这种设计不仅提高了通信效率,还大幅降低了延迟。

“从‘堆芯片’走向‘拼架构’,这是华为在AI算力领域的重大跃迁。”

换句话说,华为不再只是靠堆料取胜,而是通过系统级创新来优化整体性能。这一点,在当前全球AI算力竞争白热化的背景下,显得尤为重要。

这对国产AI意味着什么?

很多人可能不太理解这项技术的实际意义。我们可以举个例子:如果你是一个AI初创公司,过去你可能只能租用国外厂商的云服务来做训练和推理,但现在有了华为CloudMatrix 384,你可以选择更本地化、更高效的解决方案。

更重要的是,华为云强调其方案具备“高密”“高速”“高效”的特点,这意味着在同等成本下,用户可以获得更高的性价比。这对于推动大模型落地、加速行业智能化转型,有着深远影响。

未来可期还是雷声大雨点小?

当然,任何新技术的出现都会伴随着质疑。比如,有人会问:“这些指标真的能在实际应用中体现出来吗?”、“生态兼容性如何?”、“商业化进度是否跟得上?”

就我个人来看,华为这次的动作确实值得期待。虽然短期内可能还无法完全替代英伟达在高端市场的地位,但从长远看,这种系统级创新为国产算力打开了一条新的路径。

而且据我了解,目前华为已经在芜湖数据中心部署了该系统,并开始进行真实场景测试。如果后续反馈良好,我相信很快就能看到它在更多行业中的应用。

总的来说,CloudMatrix 384的发布,不仅仅是华为的一次技术秀,更是中国AI产业迈向自主可控的重要一步。

发表评论 取消回复