导读:最近,百度创始人李彦宏在公开场合提到 DeepSeek 存在较高的“幻觉率”,引发业内广泛关注。那么,什么是AI的“幻觉”?DeepSeek 真的存在这个问题吗?本文将从多个角度为你解析。

🔍 什么是AI的“幻觉”?

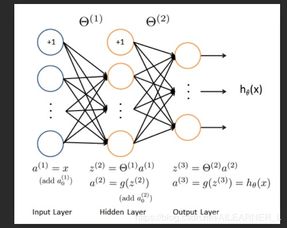

在人工智能领域,“幻觉”并不是指机器真的“看到”了什么,而是指大模型在生成内容时,输出了与事实不符、逻辑错误或完全虚构的信息。例如,一个AI可能声称某个不存在的历史事件发生过,或者引用根本不存在的研究数据。

这种现象通常出现在模型试图填补知识空白时,尤其是在面对模糊或不完整的问题时,AI会基于训练数据中的模式“编造”出看似合理的内容。

💡 李彦宏为何说 DeepSeek 幻觉高?

根据 36氪 报道,李彦宏表示,在百度内部对 DeepSeek 进行测试后发现其“幻觉率”偏高,并指出它在处理复杂任务时表现不稳定,且成本较高。

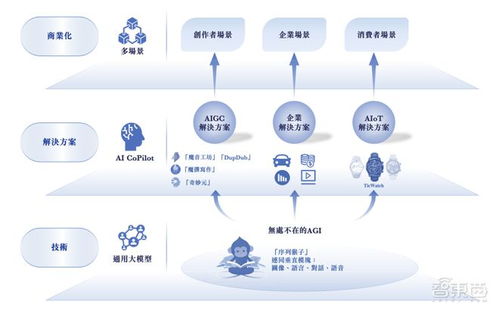

具体来说,DeepSeek 在文本生成方面表现出色,但在涉及多模态(如图像、音频、视频)理解上仍有限制。此外,由于其推理能力较强,容易生成看似有逻辑但实际错误的内容,从而导致“幻觉”问题更加突出。

📊 DeepSeek 的幻觉率到底有多高?

📊 DeepSeek 的幻觉率到底有多高?根据 Vectara HHEM 测试 数据显示:

").").

").- DeepSeek-R1 的幻觉率为 14.3%

").- 而其前身 DeepSeek-V3 的幻觉率仅为 3.9%

").

这意味着,新版模型在增强创造力和推理能力的同时,也带来了更高的“胡说八道”风险。

不过,也有专家指出,这并非 DeepSeek 独有的问题。目前市面上几乎所有大模型都存在一定程度的幻觉现象,只是程度不同而已。

🤖 百度如何使用 DeepSeek?

尽管李彦宏提出了质疑,但百度仍在积极部署 DeepSeek 模型。据 界面新闻 报道,百度旗下的 文小言、百度搜索、百度地图 等产品均已接入 DeepSeek 满血版。

这些应用在多个场景中展现出不错的用户体验,例如:

").- ").

- 智能客服的回答更自然 ").

- 搜索结果的摘要更精准 ").

- 地图推荐更个性化 ").

然而,这也意味着如果模型出现“幻觉”,可能会误导用户做出错误决策,因此百度也在加强模型的审核机制。

🚀 DeepSeek 对行业的影响

虽然幻觉问题令人担忧,但不可否认的是,DeepSeek 作为国产大模型的代表之一,确实推动了中国 AI 行业的发展。

正如 3DMGAME 所报道,不少业内人士认为 DeepSeek 是“国运级科技成果”,不仅提升了国内大模型技术的自主创新能力,也带动了上下游产业链协同发展。

尤其在科研领域,周鸿祎曾表示:“DeepSeek 的‘幻觉’在某些情况下反而具有积极价值。”因为它能激发新的研究思路,甚至帮助科学家提出新假设。

🛡️ 如何应对 AI 幻觉问题?

🛡️ 如何应对 AI 幻觉问题?随着生成式 AI 被广泛应用,如何降低幻觉风险成为各大企业关注的重点。以下是几种常见策略:

").- ").

- 引入外部知识库验证:通过连接权威数据库实时校验信息准确性 ").

- 设置逻辑检查模块:在输出前自动识别并修正明显错误 ").

- 限制模型自由发挥空间:通过设定边界条件减少“编故事”的可能性 ").

未来,随着技术的进步,AI幻觉问题有望逐步缓解,但短期内我们仍需保持警惕。

✅ 总结:DeepSeek 值得信赖吗?

总的来说,DeepSeek 作为一款高性能大模型,确实在语言理解和生成方面表现出色,但也伴随着一定的“幻觉”风险。

对于普通用户而言,建议在使用过程中保持理性判断,避免盲目相信 AI 输出的内容;而对于企业用户,则应结合自身业务需求,权衡性能与稳定性之间的关系。

如果你是开发者或研究人员,不妨尝试接入 DeepSeek,但记得做好内容审核与纠错机制。

点赞(0)

点赞(0)

发表评论 取消回复