文章导读

DeepSeek为何慢且贵 | 百度的应对策略 | 大厂们的集体追捧 | 未来趋势与思考

在百度Create2025大会上,李彦宏发布了两大模型和多款AI应用,引发了行业内外的广泛关注。与此同时,关于“DeepSeek慢且贵”的讨论也逐渐升温。作为一名普通用户和技术爱好者,我深入研究了这一现象,并试图从中找到答案。

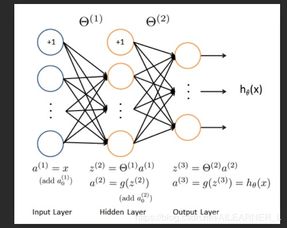

DeepSeek为何慢且贵

首先,我们需要明确的是,“慢”和“贵”并非DeepSeek本身的问题,而是其运行环境和成本结构导致的结果。根据DeepSeek官方发布的技术文章,在2月27日至28日间,平台的日均成本高达87072美元,而收入为562027美元,净赚474955美元。尽管如此,高昂的成本仍然让许多开发者望而却步。

/uploads/20250426/82647fee2dc5300bc9768ed0c1b74611.jpeg

这种高成本主要来源于两方面:一是GPU租赁费用,二是输入/输出token的定价。对于普通用户来说,这意味着每次调用DeepSeek都需要支付较高的费用,而这显然不是所有人都能承受的。

百度的应对策略

面对这种情况,百度提出了自己的解决方案。在Create2025大会上,李彦宏宣布将帮助开发者全面拥抱MCP(Model as a Cloud Platform)。通过这种方式,百度希望降低开发者的使用门槛,同时提升模型的应用效率。

具体而言,百度计划通过以下几点来实现这一目标:

- 优化模型架构,减少计算资源消耗;

- 提供更灵活的计费方式,让用户按需付费;

- 加强与其他大厂的合作,共同推动AI技术的发展。

大厂们的集体追捧

值得注意的是,DeepSeek不仅受到了百度的关注,腾讯、阿里、华为等大厂也都对其表现出浓厚兴趣。例如,腾讯不仅将旗下产品接入DeepSeek,还推出了自研的推理模型“混元T1”。而百度则选择在其搜索和文心智能体平台中全面接入DeepSeek,进一步扩大了其应用场景。

为什么这些大厂会对DeepSeek如此青睐?原因很简单——它代表了当前AI技术的最高水平。无论是模型性能还是实际应用效果,DeepSeek都展现出了强大的竞争力。然而,这也意味着竞争将更加激烈,只有那些真正具备创新能力的企业才能在市场中脱颖而出。

未来趋势与思考

展望未来,我们可以预见,AI技术将继续以惊人的速度发展。而像DeepSeek这样的高性能模型,也将成为各大企业争夺的核心资源。不过,如何平衡成本与效益,将是每个参与者都需要面对的重要课题。

作为普通用户,我们或许无法直接影响这一进程,但可以通过不断学习和尝试,更好地利用这些先进技术为自己服务。毕竟,正如李彦宏所说:“无论模型开源还是闭源,只有当基础模型能够大规模有效解决实际问题时,它才真正具有价值。”

/uploads/20250426/feca61f91a34c34ed3d27ebe1aae9d5d.jpeg

发表评论 取消回复