一、事件背景

在人工智能领域,最近发生了一件备受瞩目的大事。OpenAI成功填补了去年留下的一个巨大空白,在其模型中首次引入了奖励机制,这让整个行业都为之振奋。

二、奖励模型与Scaling Law

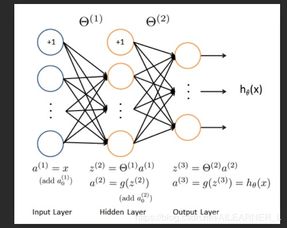

一直以来,大家都知道模型规模越大通常效果越好,这就是所谓的Scaling Law。然而,当模型达到一定规模后,继续扩大规模带来的收益就会逐渐减少。但是OpenAI这次推出的奖励模型却打破了常规认知。

这个奖励模型展现出了全新的Scaling Law特性,即便是只有1.8亿参数的小型模型,也能在某些方面超越拥有700亿参数的巨大模型。这简直就像是一个小个子打败了一个巨人,令人惊叹不已。

{% include 'toc.html' %}

三、背后的技术创新

那么,OpenAI是如何实现这一壮举的呢?这背后离不开他们在算法和技术方面的不断创新。

首先,他们在奖励模型的设计上下足了功夫。通过精心设计奖励函数,能够更好地引导模型朝着正确的方向进行学习和优化。这就像是给模型提供了一份详细的指南,让它知道哪些行为是有价值的,哪些是可以避免的。

其次,他们利用了一些先进的训练技巧。例如,采用了强化学习的方法来进一步提升模型的能力。强化学习可以让模型在与环境交互的过程中不断试错和学习,从而逐步提高自己的性能。

四、行业影响及未来展望

这一成果对整个AI行业产生了深远的影响。一方面,它让人们重新审视了模型规模与性能之间的关系。以前大家都盲目追求更大的模型,但现在发现,通过巧妙的设计和优化,小型模型也有可能取得意想不到的效果。

另一方面,这也为未来的模型研发提供了新的思路和方向。其他研究机构和公司可能会受到启发,纷纷投入到类似的研究中,尝试寻找更多打破传统Scaling Law的方法。

未来,我们可以期待看到更多的创新和突破。也许有一天,我们能够开发出更加高效、强大的AI模型,为人类带来更多的便利和福祉。

发表评论 取消回复