导读:

张文宏为何被AI盯上?

在2024年12月中旬,一则关于张文宏医生“带货”的视频在网络上疯传。不少网友出于对这位知名感染科专家的信任,不仅自己下单购买产品,还积极转发至家族群、朋友圈。

然而很快,张文宏本人出面澄清:“该视频非我本人录制,应为AI伪造。”这起事件迅速引发社会广泛关注,也让公众第一次如此直观地感受到AI技术带来的潜在风险。

腾讯如何回应张文宏AI事件?

面对此次利用AI仿冒张文宏进行营销的行为,深圳市腾讯计算机系统有限公司旗下的微信平台迅速作出反应。

2024年12月15日,微信珊瑚安全团队发布《关于打击利用AI仿冒知名人士进行营销宣传的公告》,明确表示将加强对AI生成内容的识别与监管,并采取封号、删除内容等措施,防止用户受骗。

“我们坚决反对任何利用AI技术进行虚假宣传和欺诈行为。”——微信珊瑚安全团队声明节选

AI滥用的背后,谁来负责?

这次事件并非个例,近年来随着AI技术的飞速发展,深度伪造(Deepfake)技术被滥用的情况屡见不鲜。一些不法分子利用AI合成名人形象、语音甚至签名,进行诈骗、带货等非法活动。

专家指出,AI技术本身是中性的,关键在于如何使用。而一旦被恶意利用,其后果可能远超传统造假手段。

刘忱代表曾在全国两会期间呼吁:“鼓励科技企业研发AI防御与鉴伪技术,保护公众免受AI误导。”这也成为当前社会各界关注的重点。

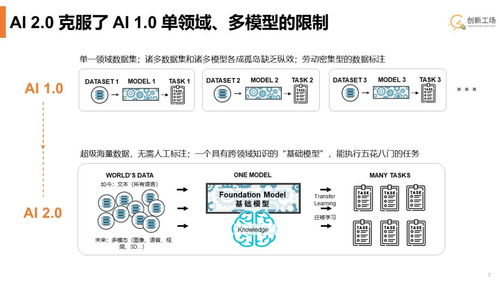

腾讯的AI布局:从防御到出击

其实早在2024年初,腾讯就已开始加速其AI领域的全面布局。从QQ浏览器、QQ音乐到腾讯文档、腾讯地图等多个核心产品线,纷纷接入大模型技术。

2025年3月,腾讯向英伟达采购数十亿元规模的H20芯片,用于支撑其AI大模型训练和应用落地。这一系列动作表明,腾讯正在构建一个从底层硬件到上层应用的完整AI生态体系。

马化腾曾在财报电话会上明确表示:“我们将持续投资于平台和包括AI在内的技术,以创造新的商业价值和更好地服务用户需求。”

未来AI治理之路怎么走?

张文宏被AI“带货”事件,暴露出当前AI监管的滞后性。虽然腾讯等科技公司已经开始行动,但要真正实现对AI内容的有效治理,还需要政府、企业和社会各界共同努力。

目前,腾讯正加快研发AI内容识别引擎,并计划推出“AI身份认证”功能,让用户可以快速识别是否为AI生成内容。同时,也在探索区块链等技术手段,为AI生成内容打上可追溯的水印。

正如吴祖榕在采访中所言:“AI的发展不能只靠技术驱动,更要以人为本,解决用户体验问题。”

张文宏医生的这次遭遇,或许只是AI时代的一个缩影。面对技术的双刃剑,我们既要享受它带来的便利,也要警惕它可能造成的伤害。而像腾讯这样的科技巨头,显然已经意识到,AI治理不仅是社会责任,更是未来发展的关键。

发表评论 取消回复