数据与算法下的AI时代腐败现象

在这个被数据与算法包围的时代,很多东西都在悄然发生着变化。算法已经深入到了生活各个角落,像早晨被智能闹钟唤醒,那闹钟可能依据睡眠数据调整叫醒时间;刷手机看到的内容也是经算法筛选过的;甚至出门打车,路线都是算法规划好的。

然而,在这看似便利的背后,却隐藏着一些令人担忧的问题,那就是AI时代的腐败现象。

在职场里,算法的存在感愈发强烈。有些企业采用高科技坐垫“监视”员工,这就像是在员工屁股底下装了个“监控”,这哪是什么和谐共处啊?这种做法无疑是对员工隐私的一种侵犯。

而且,现在AI招聘官在大厂面试中越来越常见,算法决定了外卖骑手的行进路线,“数字HR”也开始左右员工去留。算法就像一把双刃剑,一方面提高了效率,另一方面也可能带来不公平。

算法滥用的情况更是频繁发生。用户接收到的信息范围被无形限制,因为算法按照用户历史行为构建偏好模型,然后不断推送相似内容,从而形成了所谓的“信息茧房”。人们被困在这种单一信息源里,视野变得狭窄。

澳大利亚《对话》杂志报道过一个数据“中毒”的典型例子。AI系统在学习过程中,若输入错误或误导性数据,就会慢慢产生错误认知,做出不符合预期的判断。这不是传统意义上的黑客入侵,而是让AI“自己学坏”。在交通、医疗等领域广泛应用AI的情况下,这种数据“中毒”的后果不堪设想。

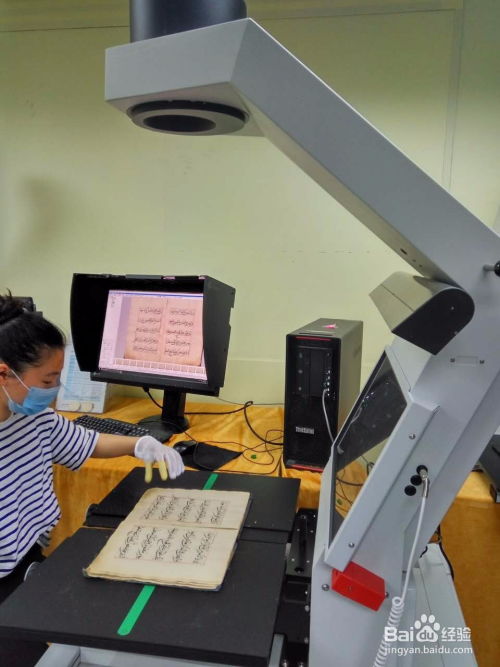

再来看看一些企业应对腐败的做法。新兴民营企业通过构建大数据风控系统、运用算法技术进行异常交易监测和关联图谱分析等手段来应对腐败问题。像腾讯、阿里这样的企业依靠自研的大数据风控系统锁定可疑行为,字节跳动也有相应措施。

云从科技对AI伦理很重视,他们在服务银行、公共安全等重要领域的时候,深知数据精准性、算法公平性、系统安全性的重要性。但在实际操作中,是不是所有企业都能像他们一样呢?

在AI时代,数据和算法如同空气一般充斥在四周,它们既带来了前所未有的机遇,也引发了新的挑战,其中腐败就是不容忽视的一环。我们需要更加警惕,采取有效措施来遏制这种腐败现象的发展。

发表评论 取消回复