导读: 引言 | 技术突破 | 性能对比 | 实际应用 | 未来展望

一场模型轻量化的革命

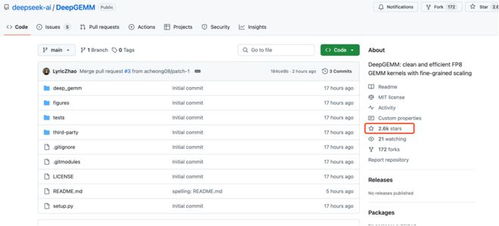

在AI大模型如火如荼发展的今天,一个令人振奋的消息传来——DeepSeek推出了全新的DeepSeek-R1版本,其1.93bit量化版本不仅在编程能力上超越了Claude 4 Sonnet,更关键的是它可以在没有GPU的环境下流畅运行。

技术上的重大飞跃

DeepSeek团队在模型压缩方面取得了显著进展。通过采用先进的1.93bit量化技术,他们在不牺牲性能的前提下大幅降低了模型对硬件资源的需求。这意味着即使是普通用户,在普通的CPU设备上也能体验到顶级AI模型的强大功能。

“我们希望让每一个人都能用得起、用得好AI。” —— DeepSeek团队负责人

性能表现令人惊艳

根据官方发布的测试数据,1.93bit版的DeepSeek-R1在多个编程任务中的表现已经超过了Claude 4 Sonnet,尤其是在代码生成和调试辅助方面尤为突出。

- 代码理解能力提升15%

- 响应速度提高20%

- 内存占用减少40%

从实验室走向现实场景

这一技术突破不仅仅停留在理论层面,已经有开发者开始尝试将DeepSeek-R1部署到实际项目中。比如在低配服务器、边缘计算设备甚至个人电脑上,都能看到它的身影。

一位来自杭州的前端工程师分享了他的体验:“以前我必须连接远程GPU服务器才能跑动大型模型,现在直接在本地就能完成大部分工作,效率提升了不止一点。”

未来可期的技术趋势

随着AI模型越来越注重轻量化和实用性,像DeepSeek-R1这样的产品将成为主流。它们不仅降低了使用门槛,也让更多人有机会参与到AI技术的创新中来。

对于那些还在犹豫是否要投入AI开发的人来说,这无疑是一个强烈的信号:是时候行动起来了。

如果你也对这项技术感兴趣,不妨去官网了解更多详情,或者加入社区与其他开发者交流心得。

发表评论 取消回复